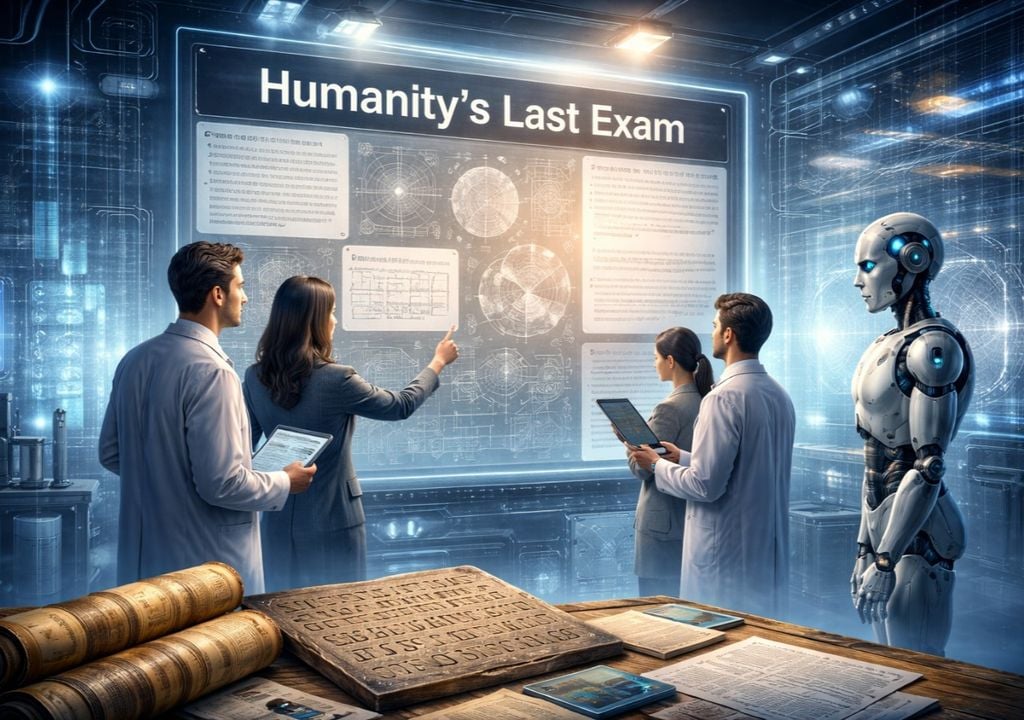

Los científicos crearon la prueba de IA más difícil de la historia, e incluso los mejores modelos están fallando

Cuando la IA empezó a superar con facilidad las pruebas que los humanos habían diseñado para ponerla a prueba, investigadores de todo el mundo decidieron crear algo que realmente no pudiera superar, y los resultados son bastante reveladores

Los investigadores llevan mucho tiempo utilizando parámetros estandarizados para medir la capacidad real de los sistemas de IA.

Pruebas como el examen de comprensión masiva del lenguaje multitarea se diseñaron para ser exigentes, abarcando una amplia gama de materias académicas y considerándose un indicador fiable de las capacidades y limitaciones de la IA. Sin embargo, el problema radica en que los sistemas de IA modernos han alcanzado tal nivel de sofisticación que dichas pruebas ya no aportan mucha información a los investigadores.

Así pues, un grupo internacional de casi 1000 investigadores, procedentes de disciplinas que van desde las matemáticas y la lingüística hasta la medicina y la historia antigua, se propuso crear algo más difícil. El resultado es "El último examen de la humanidad", una evaluación de 2500 preguntas que abarca desde matemáticas avanzadas hasta la traducción de antiguas inscripciones palmireñas, la identificación de diminutas estructuras anatómicas en aves y el análisis de las características de la pronunciación del hebreo bíblico.

Cómo se eligieron las preguntas

Entre los colaboradores de la prueba se encuentra el Dr. Tung Nguyen, profesor asociado de informática e ingeniería en la Universidad de Texas A&M, quien redactó 73 de las preguntas disponibles públicamente, la segunda mayor cantidad de cualquier colaborador individual.

"Cuando los sistemas de IA empiezan a obtener resultados excepcionales en pruebas comparativas humanas, resulta tentador pensar que se están acercando a la comprensión humana", afirmó. "Pero HLE nos recuerda que la inteligencia no se trata solo de reconocimiento de patrones, sino de profundidad, contexto y conocimientos especializados" .

Antes de su versión final, cada pregunta se probó con los principales modelos de IA. Si algún modelo respondía correctamente, la pregunta se eliminaba. El proceso de filtrado se diseñó para garantizar que el examen superara ligeramente la capacidad de procesamiento fiable de los sistemas actuales.

Los primeros resultados lo confirman. GPT-4o obtuvo un 2,7 %, Claude 3.5 Sonnet un 4,1 % y OpenAI o1 un 8 %. Sistemas más recientes, como Gemini 2.1 Pro y Claude Opus, han alcanzado entre un 40 % y un 50 %. Para evitar que los modelos se entrenen con las preguntas de antemano, la mayoría se mantienen ocultas y solo una parte se publica.

Nguyen afirmó que la necesidad de contar con puntos de referencia fiables va más allá del interés académico: "Sin herramientas de evaluación precisas, los responsables políticos, los desarrolladores y los usuarios corren el riesgo de malinterpretar lo que los sistemas de IA pueden hacer realmente."

Añadió que los puntos de referencia proporcionan la base para medir el progreso e identificar los riesgos.

No es una advertencia, sino una herramienta de medición

A pesar de su nombre, los investigadores recalcaron que el examen no pretende afirmar que la IA esté superando la experiencia humana. El objetivo es ofrecer una visión más clara y honesta de las limitaciones que aún presentan los sistemas de IA, y establecer un punto de referencia que siga siendo útil a medida que los modelos continúen mejorando.

"Esto no es una carrera contra la IA", dijo Nguyen. "Es un método para comprender dónde destacan estos sistemas y dónde presentan dificultades. Esta comprensión nos ayuda a desarrollar tecnologías más seguras y fiables. Y, lo que es más importante, nos recuerda por qué la experiencia humana sigue siendo fundamental".

Nguyen añadió que expertos de casi todas las disciplinas contribuyeron a la colaboración, y es esa amplitud de conocimiento humano, según él, lo que hace visibles las deficiencias en el rendimiento de la IA de una manera que las pruebas más específicas no logran.

Referencia de la noticia

Scientists built the hardest AI test ever and the results are surprising, published by Texas A&M University, March 2026.

No te pierdas la última hora de Meteored y disfruta de todos nuestros contenidos en Google Discover totalmente GRATIS

+ Seguir a Meteored